تعهدت شركات التكنولوجيا الكبرى بتبني “الاحتياطات اللازمة” بشكل طوعي، إثر توقيع “اتفاق رمزي”، لتجنب استغلال أدوات الذكاء الاصطناعي في التلاعب بالانتخابات الديمقراطية في جميع أنحاء العالم، فيما طوّرت شركة أميركية ناشئة في هذا المجال، تقنية لمنع ما وصفته بـ”الهلوسة” الانتخابية.

واجتمع مديرون تنفيذيون من شركات أمازون، وجوجل، وIBM، وميتا، ومايكروسوفت، وAdobe، وOpenAI، و”تيك توك” خلال مؤتمر ميونخ للأمن، الجمعة، للإعلان عن إطار عمل جديد لكيفية التصدي لعمليات التزييف الناتجة عن الذكاء الاصطناعي، التي تخدع الناخبين بشكل متعمد، وفق ما أوردت وكالة “أسوشيتد برس” الأميركية.

كما وقعت 12 شركة أخرى، تشمل منصة التواصل “إكس” المملوكة للملياردير الأميركي إيلون ماسك على الاتفاقية.

وقال نيك كليج رئيس الشؤون الدولية في شركة “ميتا”، التي تمتلك منصات فيسبوك وإنستجرام وواتساب، خلال مقابلة قبل المؤتمر: “الجميع يدركون أنه لا يمكن لأي شركة تكنولوجيا، ولا حكومة، ولا منظمة مجتمع مدني قادرة على التعامل بمفردها مع ظهور هذه التكنولوجيا واستخدامها المسيء المحتمل”.

ولفت إلى أن كل شركة “لديها على نحو مناسب تماماً مجموعة خاصة بها من سياسات المحتوى”.

وأضاف: “هذه ليست محاولة لفرض قيود على الجميع. وعلى أي حال، لا أحد في الصناعة يعتقد أنه يمكنك التعامل مع نموذج تقني جديد تماماً من خلال التغاضي عن الأمور، ومحاولة انتهاج مسعى لا جدوى منه والعثور على كل ما تعتقد أنه ربما يضلل أحدهم”.

“اتفاق رمزي”

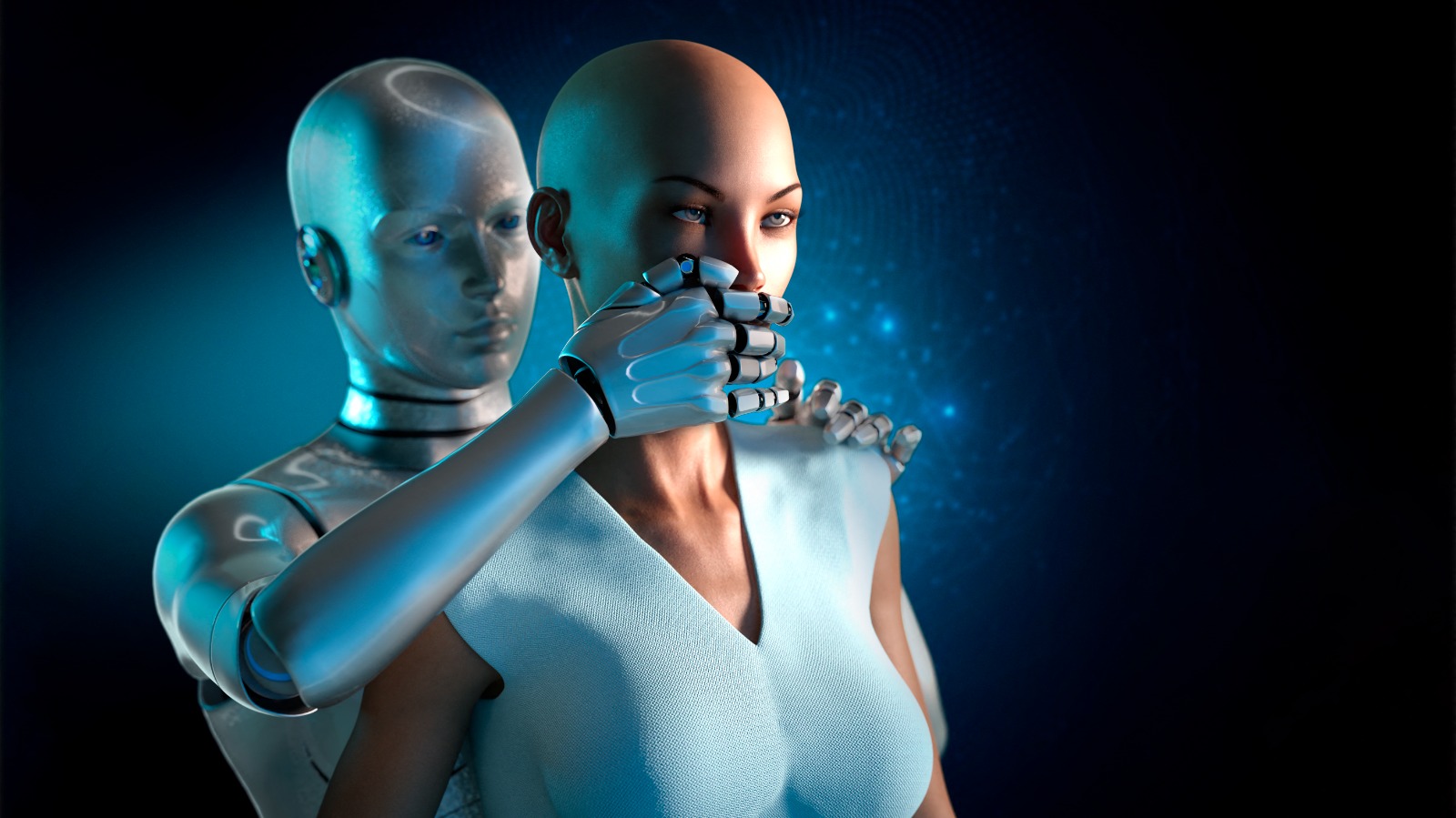

“أسوشيتد برس” اعتبرت أن الاتفاق يعد “رمزياً” إلى حد كبير؛ ولكنه يستهدف بشكل متزايد الصور ومقاطع الصوت والفيديو التي تنتج بواسطة الذكاء الاصطناعي، “والتي تزيف أو تغير بشكل خادع مظهر أو صوت أو تصرفات مرشحين سياسيين ومسؤولي انتخابات وغيرهم من الأطراف المعنية الرئيسية في انتخابات ديمقراطية، أو التي تقدم معلومات خاطئة للناخبين بشأن موعد ومكان وكيفية التصويت بشكل قانوني”.

والاتفاق لا يُلزم الشركات بحظر أو إزالة المحتوى المولد بالتزييف العميق؛ وبدلاً من ذلك، يحدد الأساليب التي ستستخدمها لمحاولة رصد وتصنيف محتوى الذكاء الاصطناعي الخادع، عند إنشائه أو نشره على منصاتها.

ويشير الاتفاق إلى أن الشركات ستشارك أفضل الممارسات مع بعضها البعض، وستقدم “استجابات سريعة ومتناسبة”، عندما يبدأ هذا المحتوى في الانتشار.

ويدعو الاتفاق المنصات، إلى “الانتباه إلى السياق وخاصة حماية التعبير التعليمي، والوثائقي والفني والساخر والسياسي”.

وقال إن الشركات ستركز على الشفافية أمام المستخدمين بشأن سياساتها، وستعمل على تثقيف الجمهور بشأن طريقة تجنب الوقوع في فخ الذكاء الاصطناعي المزيف.

“صياغة ليست قوية”

ورجحت الوكالة، أن “غموض الالتزامات، وعدم وجود أي شروط مُلزمة”، ربما ساعد في جذب شريحة متنوعة من الشركات، لكن مدافعين يشعرون بخيبة أمل كانوا يبحثون عن ضمانات أقوى.

ونقلت الوكالة عن راشيل أوري كبيرة مساعدي إدارة “مشروع الانتخابات” في “مركز السياسات الحزبية” وهو مؤسسة أبحاث مقرها واشنطن، قولها، إن “الصياغة ليست قوية جداً بقدر ما كان متوقعاً”.

وأضافت أوري: “أعتقد أننا يجب أن ننسب الفضل لمن يستحقه، ونعترف بأن الشركات لديها مصلحة شخصية في عدم استخدام أدواتها لتقويض الانتخابات الحرة والنزيهة. مع ذلك، الأمر طوعي، وسنراقب ما إذا كانوا سينفذون ذلك أم لا”.

وأعلن العديد من القادة السياسيين من أوروبا والولايات المتحدة انضمامهم أيضاً إلى إعلان يوم الجمعة. وقالت نائبة رئيس المفوضية الأوروبية فيرا جوروفا، إنه على الرغم من أن مثل هذا الاتفاق لا يمكن أن يكون شاملاً، فإنه “يحتوي على عناصر مؤثرة وإيجابية للغاية”.

كما شجعت جوروفا، زملائها السياسيين، على تحمل مسؤولية عدم استخدام أدوات الذكاء الاصطناعي بشكل خادع، محذرة من أن المعلومات المضللة التي يعززها الذكاء الاصطناعي يمكن أن تؤدي إلى “نهاية الديمقراطية، ليس فقط في الدول الأعضاء في الاتحاد الأوروبي”.

ويأتي الاتفاق الذي توصلت إليه الشركات خلال الاجتماع الأمني السنوي في ميونخ، في الوقت الذي من المقرر أن تجري فيه أكثر ممن 50 دولة انتخابات وطنية في عام 2024. وشهدت كل بنجلاديش وتايوان وباكستان ومؤخراً إندونيسيا انتخابات بالفعل.